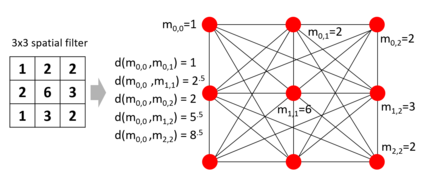

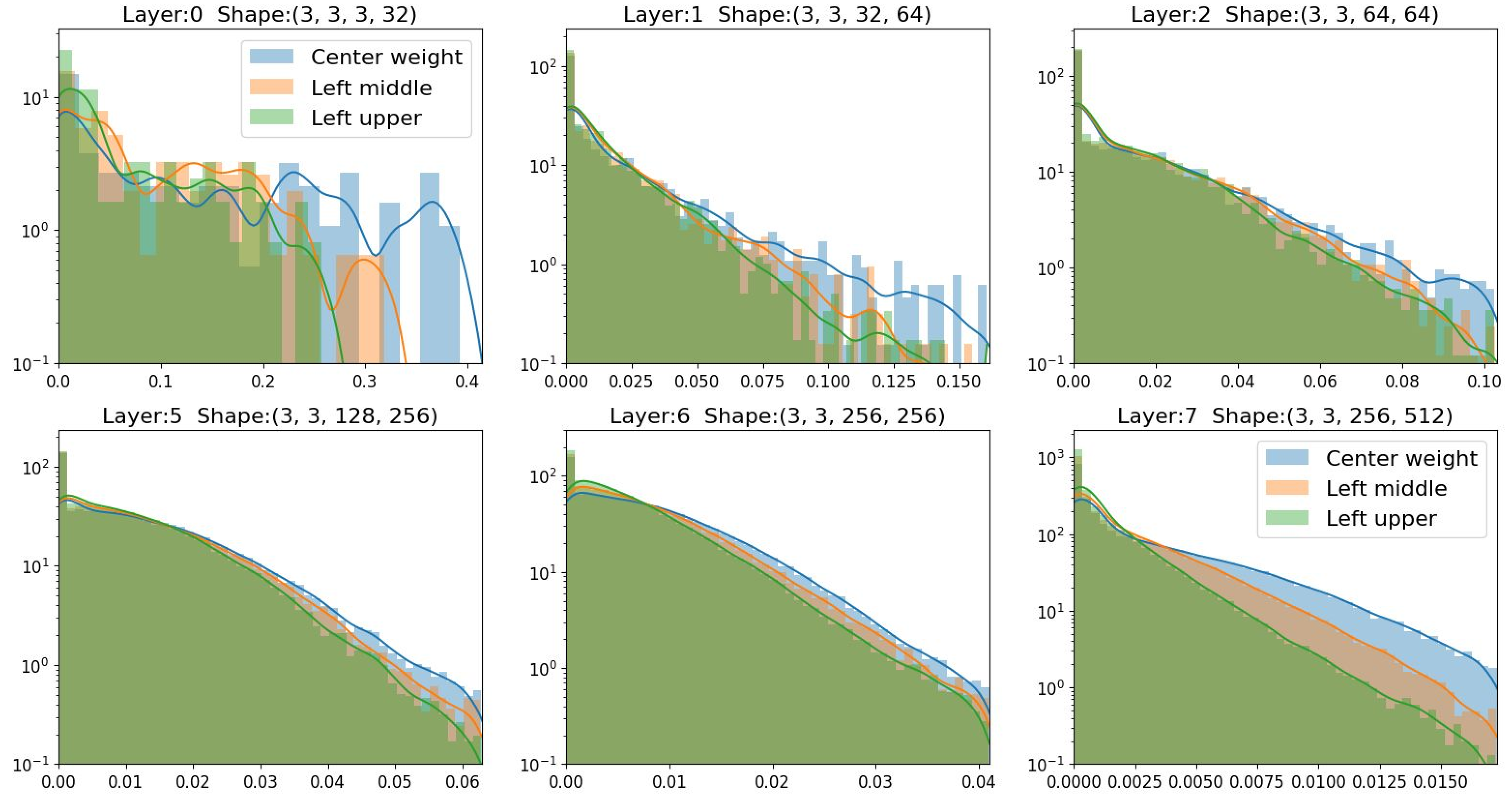

This work investigates fundamental questions related to learning features in convolutional neural networks (CNN). Empirical findings across multiple architectures such as VGG, ResNet, Inception, DenseNet and MobileNet indicate that weights near the center of a filter are larger than weights on the outside. Current regularization schemes violate this principle. Thus, we introduce Locality-promoting Regularization (LOCO-Reg), which yields accuracy gains across multiple architectures and datasets. We also show theoretically that the empirical finding is a consequence of maximizing feature cohesion under the assumption of spatial locality.

翻译:这项工作调查了与进化神经网络(CNN)中学习特征有关的基本问题。 VGG、ResNet、Inception、DenseNet和移动网络等多个结构的实证调查结果表明,过滤器中心附近的重量大于外部重量。目前的正规化计划违反了这一原则。因此,我们引入了促进本地化的正规化(LOCO-Reg),在多个结构和数据集中产生准确性收益。我们从理论上也表明,实证结论是空间地点假设下最大程度特征凝聚力的结果。