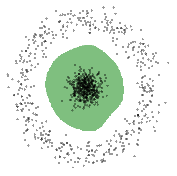

The dissimilarity mixture autoencoder (DMAE) is a neural network model for feature-based clustering that incorporates a flexible dissimilarity function and can be integrated into any kind of deep learning architecture. It internally represents a dissimilarity mixture model (DMM) that extends classical methods like K-Means, Gaussian mixture models, or Bregman clustering to any convex and differentiable dissimilarity function through the reinterpretation of probabilities as neural network representations. DMAE can be integrated with deep learning architectures into end-to-end models, allowing the simultaneous estimation of the clustering and neural network's parameters. Experimental evaluation was performed on image and text clustering benchmark datasets showing that DMAE is competitive in terms of unsupervised classification accuracy and normalized mutual information. The source code with the implementation of DMAE is publicly available at: https://github.com/juselara1/dmae

翻译:不同混合物自动编码器(DMAE)是一种基于特性的集群的神经网络模型,它包含灵活的不同功能,可以纳入任何深度学习结构,内部代表一种不同混合物模型(DMMM),将K-Means、Gaussian混合物模型或Bregman集群等古典方法扩展至任何同类和不同不同功能,通过将概率重新解释为神经网络表示方式,DMAE可以与深层学习结构整合到终端至终端模型中,允许同时估计集群和神经网络参数。对图像和文本组合基准数据集进行了实验性评估,显示DMAE在非监督分类精度和标准化的相互信息方面具有竞争力。DMAE实施源代码公布于https://github.com/juselara1/dmae: