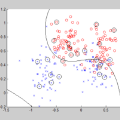

Score-based generative models require guidance in order to generate plausible, on-manifold samples. The most popular guidance method, Classifier-Free Guidance (CFG), is only applicable in settings with labeled data and requires training an additional unconditional score-based model. More recently, Auto-Guidance adopts a smaller, less capable version of the original model to guide generation. While each method effectively promotes the fidelity of generated data, each requires labeled data or the training of additional models, making it challenging to guide score-based models when (labeled) training data are not available or training new models is not feasible. We make the surprising discovery that the positive curvature of log density estimates in saddle regions provides strong guidance for score-based models. Motivated by this, we develop saddle-free guidance (SFG) which maintains estimates of maximal positive curvature of the log density to guide individual score-based models. SFG has the same computational cost of classifier-free guidance, does not require additional training, and works with off-the-shelf diffusion and flow matching models. Our experiments indicate that SFG achieves state-of-the-art FID and FD-DINOv2 metrics in single-model unconditional ImageNet-512 generation. When SFG is combined with Auto-Guidance, its unconditional samples achieve general state-of-the-art in FD-DINOv2 score. Our experiments with FLUX.1-dev and Stable Diffusion v3.5 indicate that SFG boosts the diversity of output images compared to CFG while maintaining excellent prompt adherence and image fidelity.

翻译:基于分数的生成模型需要引导机制才能生成合理的流形样本。最流行的引导方法——无分类器引导(CFG)——仅适用于带标签数据的场景,且需要额外训练一个无条件的基于分数模型。近期提出的自动引导方法则采用原模型的一个较小、能力较弱的版本来引导生成。虽然这些方法都能有效提升生成数据的保真度,但均需要标签数据或训练额外模型,这使得在(带标签)训练数据不可用或训练新模型不可行时,难以引导基于分数的模型。我们意外地发现,对数密度估计在鞍点区域的正曲率为基于分数模型提供了强有力的引导。受此启发,我们开发了无鞍点引导(SFG)方法,该方法通过维持对数密度最大正曲率的估计来引导单个基于分数模型。SFG具有与无分类器引导相同的计算成本,无需额外训练,且可与现成的扩散模型和流匹配模型配合使用。实验表明,在单模型无条件ImageNet-512生成任务中,SFG在FID和FD-DINOv2指标上达到了最先进水平。当SFG与自动引导结合时,其无条件样本在FD-DINOv2分数上取得了全面的最优性能。我们在FLUX.1-dev和Stable Diffusion v3.5上的实验表明,与CFG相比,SFG在保持出色提示遵循度和图像保真度的同时,显著提升了输出图像的多样性。