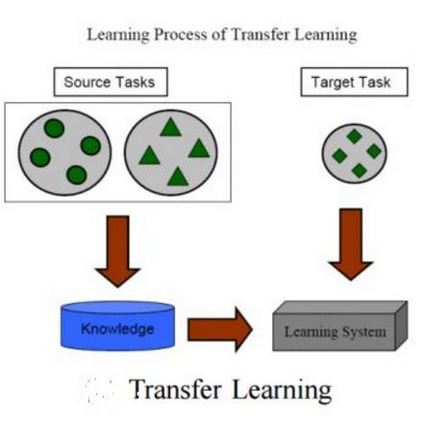

Detection of diseases through medical imaging is preferred due to its non-invasive nature. Medical imaging supports multiple modalities of data that enable a thorough and quick look inside a human body. However, interpreting imaging data is often time-consuming and requires a great deal of human expertise. Deep learning models can expedite interpretation and alleviate the work of human experts. However, these models are data-intensive and require significant labeled images for training. During novel disease outbreaks such as Covid-19, we often do not have the required labeled imaging data, especially at the start of the epidemic. Deep Transfer Learning addresses this problem by using a pretrained model in the public domain, e.g. any variant of either VGGNet, ResNet, Inception, DenseNet, etc., as a feature learner to quickly adapt the target task from fewer samples. Most pretrained models are deep with complex architectures. They are trained with large multi-class datasets such as ImageNet, with significant human efforts in architecture design and hyper parameters tuning. We presented 1 a simpler generative source model, pretrained on a single but related concept, can perform as effectively as existing larger pretrained models. We demonstrate the usefulness of generative transfer learning that requires less compute and training data, for Few Shot Learning (FSL) with a Covid-19 binary classification use case. We compare classic deep transfer learning with our approach and also report FSL results with three settings of 84, 20, and 10 training samples. The model implementation of generative FSL for Covid-19 classification is available publicly at https://github.com/suvarnak/GenerativeFSLCovid.git.

翻译:医学成像支持多种数据模式,使得能够对人体进行彻底和快速的检查。然而,对成像数据进行解释往往耗费时间,需要大量的人类专门知识。深层次学习模式可以加快解读和减轻人类专家的工作。然而,这些模型是数据密集型的,需要大量的标签图像来进行培训。在Covid-19等新型疾病爆发期间,我们往往没有所需的贴标签成像数据,特别是在该流行病开始时。深层传输学习通过在公共领域使用预先训练的模型来解决这个问题,例如,VGGNet、ResNet、Inptionion、DenseNet等任何变种,作为从较少的样本中迅速调整目标任务的特点学习者。这些模型大多是数据密集型的,如图像网,在结构设计和超常参数调控中,我们往往没有明显的人类模型。我们提出了一个更简单的基因化源模型,在单一但相关的概念上经过预先训练,可以有效地将VGGNet、ResNet、ResNet、Incionionionion、DenseNet等变现为更小的C-L分类。我们学习前的学习模型,我们学习了10级L的模型。我们学习了10级分类的学习模型,我们学习了学习的学习的学习的学习的BRVL的BRFS 。我们学习的BL 学习了10 学习的样样样样样样样样样样样样样。我们学习了学习了10的样样。