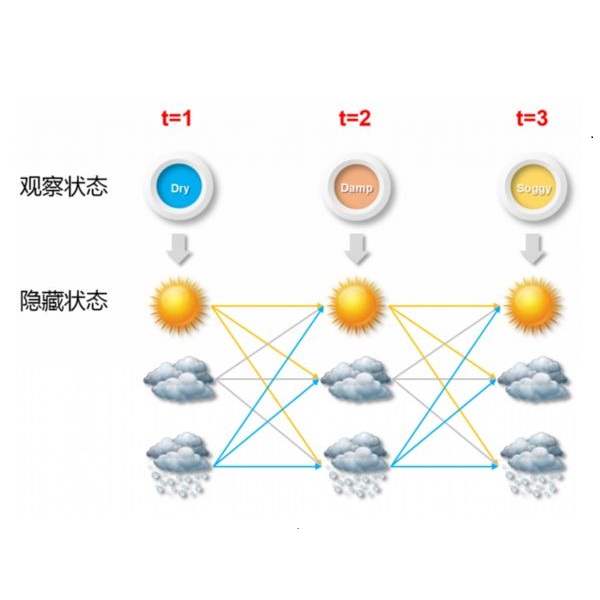

We propose a unified framework that extends the inference methods for classical hidden Markov models to continuous settings, where both the hidden states and observations occur in continuous time. Two different settings are analyzed: (1) hidden jump process with a finite state space; (2) hidden diffusion process with a continuous state space. For each setting, we first estimate the hidden state given the observations and model parameters, showing that the posterior distribution of the hidden states can be described by differential equations in continuous time. Then we consider the estimation of unknown model parameters, deriving the formulas for the expectation-maximization algorithm in the continuous-time setting. We also propose a Monte Carlo method for sampling the posterior distribution of the hidden states and estimating the unknown parameters.

翻译:我们提出了一个统一框架,将古典隐蔽的马尔科夫模型的推断方法扩大到连续设置,其中隐藏状态和观测都发生在连续时间。我们分析了两种不同的设置:(1) 隐藏跳跃过程,有一定的状态空间;(2) 隐藏扩散过程,有连续的状态空间。我们首先根据观察和模型参数来估计隐藏状态的隐藏状态,表明隐藏状态的后方分布可以连续用不同的方程描述。然后我们考虑对未知模型参数的估计,从中得出连续设置的预期-最大化算法公式。我们还提出了蒙特卡洛方法,用于取样隐藏状态的外表分布和估计未知参数。

相关内容

Source: Apple - iOS 8