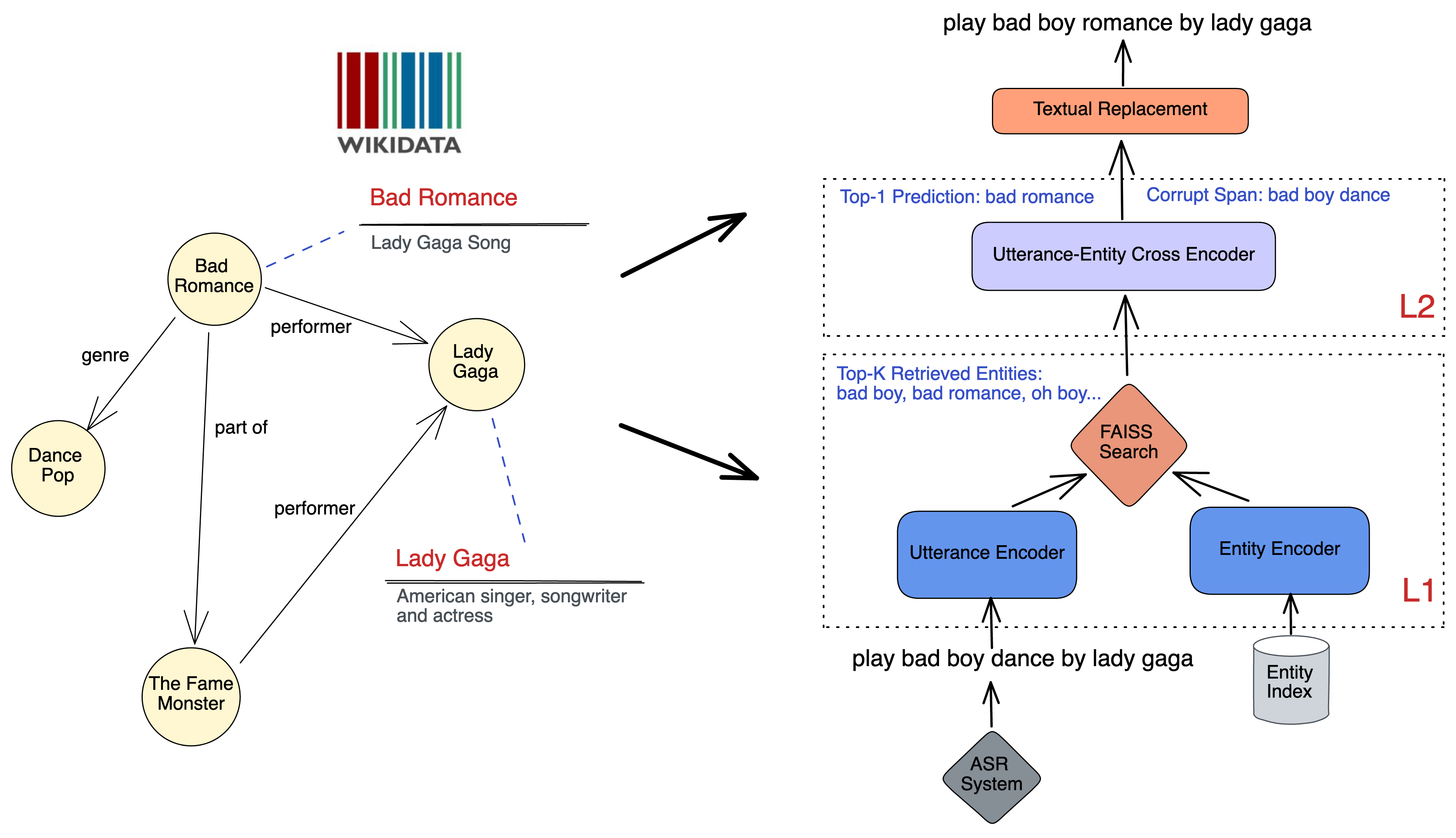

Query Rewriting (QR) plays a critical role in large-scale dialogue systems for reducing frictions. When there is an entity error, it imposes extra challenges for a dialogue system to produce satisfactory responses. In this work, we propose KG-ECO: Knowledge Graph enhanced Entity COrrection for query rewriting, an entity correction system with corrupt entity span detection and entity retrieval/re-ranking functionalities. To boost the model performance, we incorporate Knowledge Graph (KG) to provide entity structural information (neighboring entities encoded by graph neural networks) and textual information (KG entity descriptions encoded by RoBERTa). Experimental results show that our approach yields a clear performance gain over two baselines: utterance level QR and entity correction without utilizing KG information. The proposed system is particularly effective for few-shot learning cases where target entities are rarely seen in training or there is a KG relation between the target entity and other contextual entities in the query.

翻译:查询重写(QR)在减少摩擦的大型对话系统中发挥着关键作用。 当出现实体错误时, 它会给对话系统带来额外的挑战, 以产生令人满意的回应。 在这项工作中, 我们提议 KG- ECO: 知识图表: 实体强化校正以重写查询, 一个有腐败实体的实体校正系统, 覆盖检测和实体检索/ 重新排位功能。 为了提升模型性能, 我们纳入了知识图( KG), 以提供实体结构信息( 由图形神经网络编码的相邻实体) 和文本信息( 由 ROBERTA 编码的 KG 实体描述 ) 。 实验结果显示, 我们的方法在两个基线上取得了明显的绩效收益: 语音QR 和 实体校正, 不使用 KG 信息 。 拟议的系统对于少数短小的学习案例特别有效, 在这些案例中, 目标实体在培训中很少看到, 或者在查询中的目标实体与其他背景实体之间存在 KG 关系 。