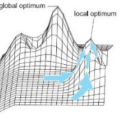

The $(1 + (\lambda,\lambda))$ genetic algorithm is a younger evolutionary algorithm trying to profit also from inferior solutions. Rigorous runtime analyses on unimodal fitness functions showed that it can indeed be faster than classical evolutionary algorithms, though on these simple problems the gains were only moderate. In this work, we conduct the first runtime analysis of this algorithm on a multimodal problem class, the jump functions benchmark. We show that with the right parameters, the \ollga optimizes any jump function with jump size $2 \le k \le n/4$ in expected time $O(n^{(k+1)/2} e^{O(k)} k^{-k/2})$, which significantly and already for constant~$k$ outperforms standard mutation-based algorithms with their $\Theta(n^k)$ runtime and standard crossover-based algorithms with their $\tilde{O}(n^{k-1})$ runtime guarantee. For the isolated problem of leaving the local optimum of jump functions, we determine provably optimal parameters that lead to a runtime of $(n/k)^{k/2} e^{\Theta(k)}$. This suggests some general advice on how to set the parameters of the \ollga, which might ease the further use of this algorithm.

翻译:$(1 + ( lambda,\ lambda,\ lambda) 的基因算法是一种较年轻的进化算法, 试图从低级解决方案中获利。 对单式健身功能的严格运行时间分析显示, 它确实能够比经典进化算法更快, 尽管在这些简单的问题上, 收益只是中等的。 在这项工作中, 我们用一个多式问题类, 跳跃函数基准, 对这个算法进行首次运行时间分析。 我们显示, 在正确的参数下, \ olga 优化任何跳跃函数, 以跳跃大小 2\ le k k\le n/4$ 来优化任何跳跃函数 $ (n ⁇ (k+1) /2} e e(k) k} k} k} k( k)- k) 运行时间 。 对于离开本地最佳跳跃函数的孤立问题, 我们决定一个最优的参数, 将如何运行到一个固定的 。