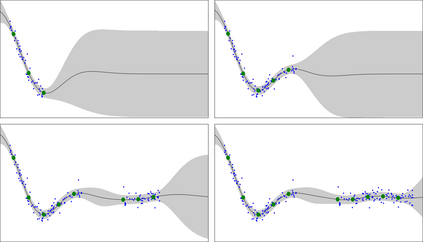

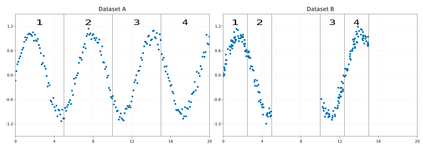

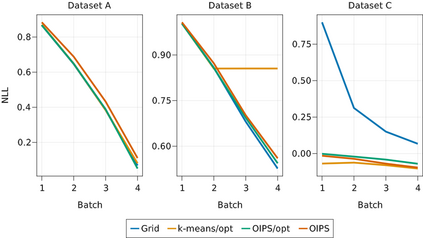

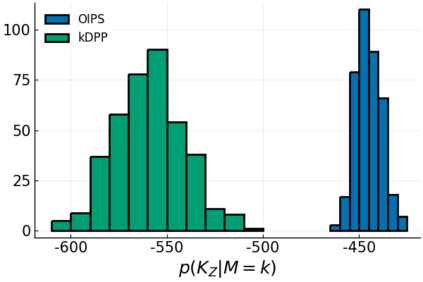

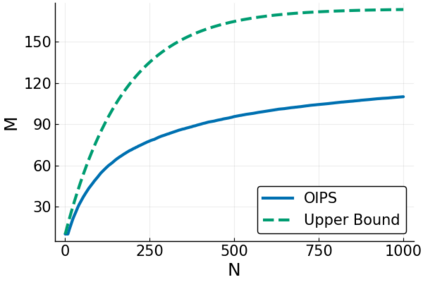

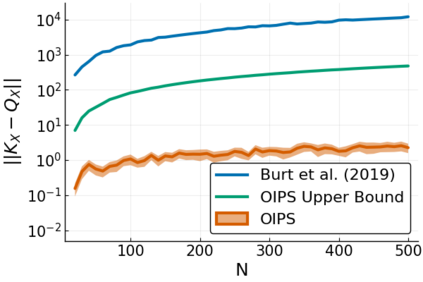

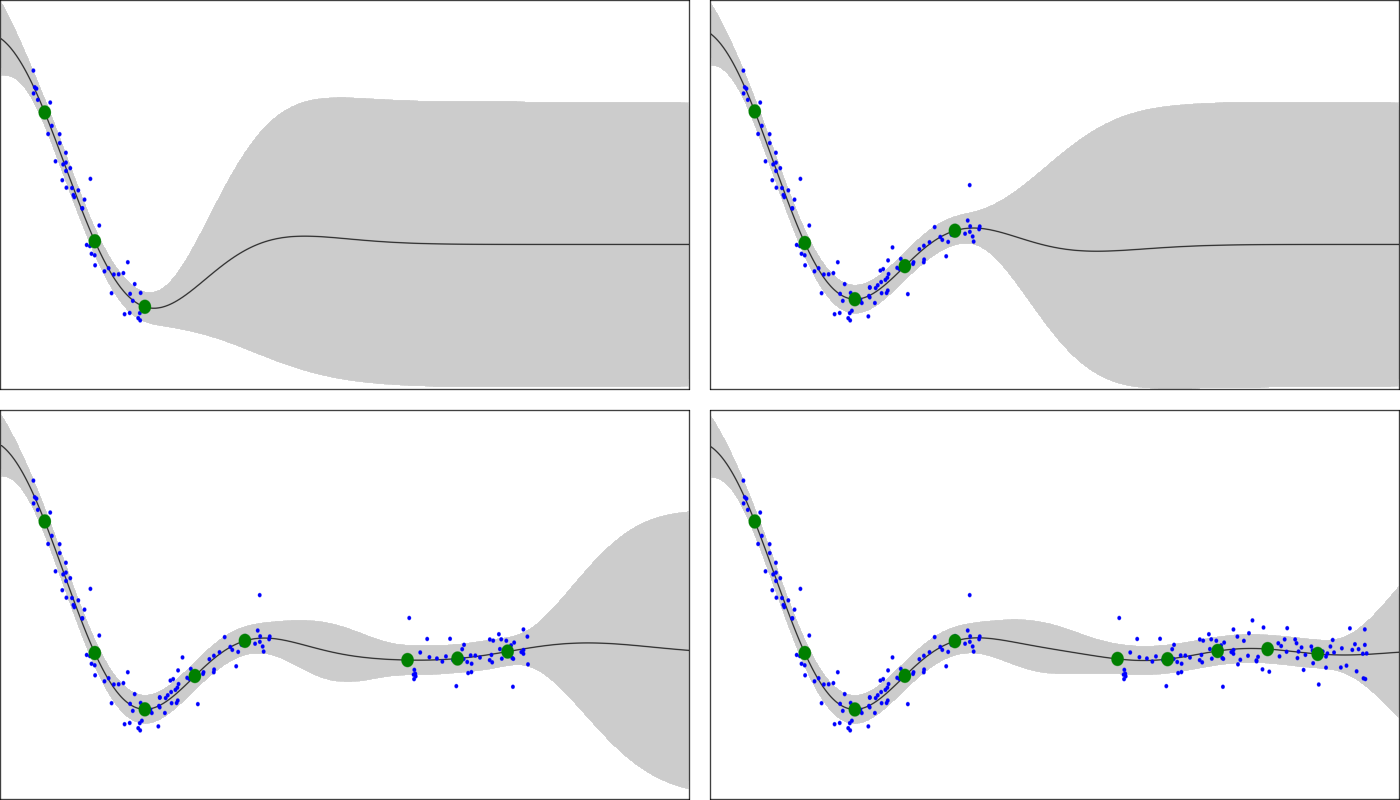

Gaussian Processes (\textbf{GPs}) are flexible non-parametric models with strong probabilistic interpretation. While being a standard choice for performing inference on time series, GPs have few techniques to work in a streaming setting. \cite{bui2017streaming} developed an efficient variational approach to train online GPs by using sparsity techniques: The whole set of observations is approximated by a smaller set of inducing points (\textbf{IPs}) and moved around with new data. Both the number and the locations of the IPs will affect greatly the performance of the algorithm. In addition to optimizing their locations, we propose to adaptively add new points, based on the properties of the GP and the structure of the data.

翻译:Gausian processes (\ textbf{GPs}) 是灵活的非参数模型, 具有很强的概率解释。 虽然GP是进行时间序列推论的标准选择, 但GP在串流环境中几乎没有什么方法可以工作 。\ cite{bui2017 流化} 开发了一种高效的变通方法, 通过使用宽度技术来培训在线GP: 整个一组观测都以更小的一组引导点(\ textbf{IPs} ) 相近, 并随新数据而移动。 IPs的数量和位置都会极大地影响算法的性能。 除了优化其位置外, 我们提议根据GP的特性和数据结构, 适应性地添加新的点 。