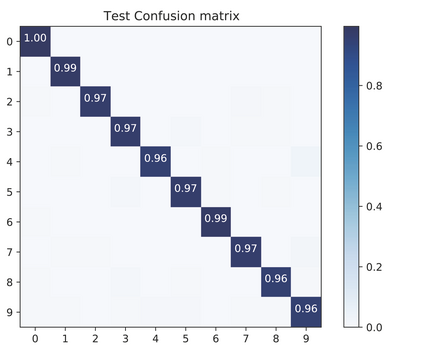

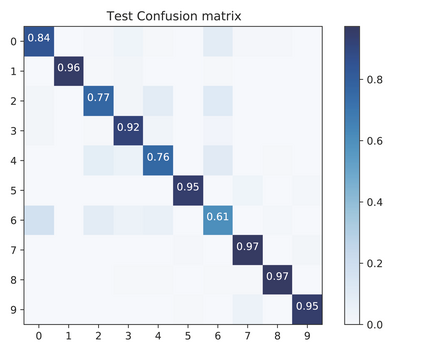

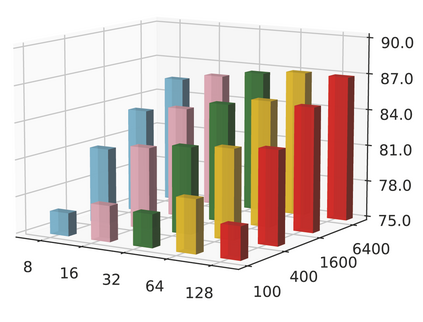

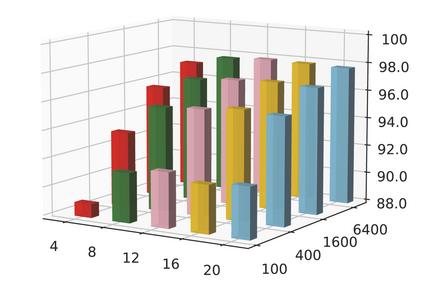

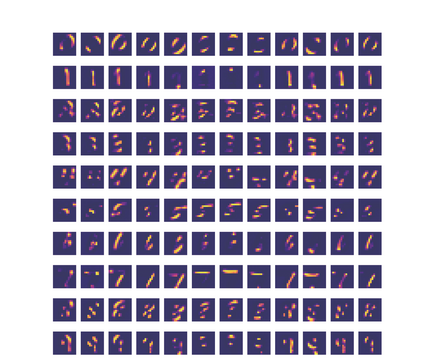

The backpropagation algorithm has promoted the rapid development of deep learning, but it relies on a large amount of labeled data, and there is still a large gap with the way the human learns. The human brain can rapidly learn various concept knowledge in a self-organized and unsupervised way, which is accomplished through the coordination of multiple learning rules and structures in the human brain. Spike-timing-dependent plasticity (STDP) is a widespread learning rule in the brain, but spiking neural network trained using STDP alone are inefficient and performs poorly. In this paper, taking inspiration from the short-term synaptic plasticity, we design an adaptive synaptic filter, and we introduce the adaptive threshold balance as the neuron plasticity to enrich the representation ability of SNNs. We also introduce an adaptive lateral inhibitory connection to dynamically adjust the spikes balance to help the network learn richer features. To accelerate and stabilize the training of the unsupervised spiking neural network, we design a sample temporal batch STDP which update the weight based on multiple samples and multiple moments. We have conducted experiments on MNIST and FashionMNIST, and have achieved state-of-the-art performance of the current unsupervised spiking neural network based on STDP. And our model also shows strong superiority in small samples learning.

翻译:背面调整算法促进了深层学习的快速发展,但它依赖大量标签数据,与人类学习的方式仍然存在着巨大的差距。人类大脑可以通过自我组织和不受监督的方式迅速学习各种概念知识,这是通过协调多种学习规则和结构在人类大脑中实现的。斯派牵引依赖塑料(STDP)是大脑中一个广泛的学习规则,但单靠STDP培训的神经神经网络是低效的,运行不良。在本文中,我们从短期合成造型中汲取了灵感,设计了一个适应性合成过滤器,我们引入了适应性临界平衡,作为神经可塑性,以丰富SNNNPs的代表能力。我们还引入了适应性横向抑制性连接,以动态调整峰值平衡,帮助网络学习更富的特征。为了加速和稳定对未经监视的神经网络的培训,我们设计了一个模范的TISDP样本,根据多个样本和小片段更新了重量。我们在SDIMISS的模型中进行了超强的测试。我们还在SMISIST和FASIMIS的模型上进行了超强的测试。