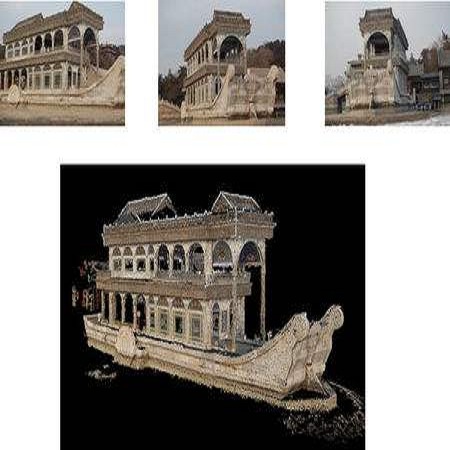

AlphaSurf:我们提出了一种新型隐式表示方法,结合了解耦的几何结构与表面不透明度,并基于网格架构以支持复杂或半透明物体的高精度表面重建。与传统仅建模几何和外观的方式不同,AlphaSurf将射线-表面交点的求解与交点的不透明度建模分别处理,同时保持两者的可微性,从而支持基于光度损失的解耦优化。其交点通过三次多项式的解析解获得,无需蒙特卡洛采样,因此具有完备的可微性;另外,配合网格结构的不透明度与辐射场建模,实现了纯RGB图像驱动的重建。 1. D²NeRF:针对静态场景中常见的动态噪声与遮挡物问题(如街景扫描中出现的人、车、植物等),我们提出一种可将动态因素从静态场景中解耦的重建方法。该方法可从普通手机视频中恢复静态三维场景,并同时建模三维与四维对象。通过引入自由度约束实现动态解耦,无需语义先验,因此对诸如流动液体或移动阴影等非典型动态噪声也具备良好适应性。 1. 轻量高频建模:为提升重建效率,我们提出一种用于简单几何但高频外观的场景建模方法,尤其适用于神经人像中的高频衣物纹理。该方法通过稀疏锚点构建3D到2D纹理空间的对应关系,在保证表达力的同时大幅简化表示形式,配合神经形变建模,实现了精细外观的轻量级建模。

综上所述,本论文全面综述了神经隐式表示及其在基于RGB图像的三维重建中的应用,并通过提出一系列方法,在应对实际挑战(如半透明表面、动态遮挡、外观高频等)方面取得了显著进展。我们表明,只有在表示、架构与优化策略上进行有针对性的设计,才能有效应对图像驱动三维重建中高度不适定的问题。通过合理方法设计,我们可以仅依赖有位姿信息的多视图图像或单目视频,实现对透明体表面、动态遮挡物剔除及高频外观的高效建模与重建。

https://www.repository.cam.ac.uk/items/1eb37661-8efa-41a0-a36e-3b20511d6650