当小型无人机系统(sUAS)由疏忽、鲁莽或恶意操作者操控时,将对地方及联邦机构构成重大威胁。随着sUAS与传统航空器共享空域的情况日益增多,且其可能作为武器侵入管制空域,人员、设施及资产防护已成为核心议题。本研究通过集成低成本分布式传感器与机器学习(ML)模型,提升战场态势感知能力,补强现有传感平台对sUAS的实时探测、分类与定位效能。

本文提出"无人机侦测指挥中心"(DDCC)概念架构。该系统对接分布式节点网络,通过声学与光学双模态实时获取sUAS数据,并具备截取关键帧能力以增强未来机器学习模型的预测性能。基于大疆Matrice 600 Pro采集的数据集,构建多组深度学习模型实现sUAS存在性分类及节点距离预测。重点评估声学测距性能(与光学测距对比),最终融合多源数据构建定制模型,验证融合数据是否优于单模态方案。初步实验显示:声学分类准确率79.6%,光学分类准确率86.7%;独立测距任务中声学平均绝对误差10.463米,光学误差16.961米;经卷积循环神经网络处理融合数据后,平均绝对误差降至9.57米,较声学数据提升0.88米,较光学数据提升7.385米。

本章首先阐明研究问题与目标,随后介绍DDCC系统——该专有平台可同步联动多传感器执行"记录"与"预测"指令。

在sUAS激增的背景下,无论操作者性质(疏忽/恶意/军事),均对地方及联邦机构安全构成紧迫威胁。面对sUAS与传统航空器空域共享及其武器化趋势,人员设施防护已成关键挑战。本研究旨在验证"低成本分布式传感器+ML模型"在sUAS探测、分类及测距中的有效性,并构建DDCC系统——该系统可加载预训练模型,基于视频、音频及融合数据实现sUAS存在性识别与距离测算。

本文致力于解决空基威胁探测的多维挑战(特指sUAS),通过在DDCC中融合"声学特征卷积循环神经网络"(CRNN)与"YOLOv8目标检测模型",构建可实时识别、分类及测距的全域解决方案。研究目标明确如下:

- 一体化架构集成:研究CRNN声学分析与YOLOv8视觉检测在DDCC中的无缝融合,设计优化双模态协同架构

- 声学测距回归模型:构建训练CRNN实现声源测距(单位:米)

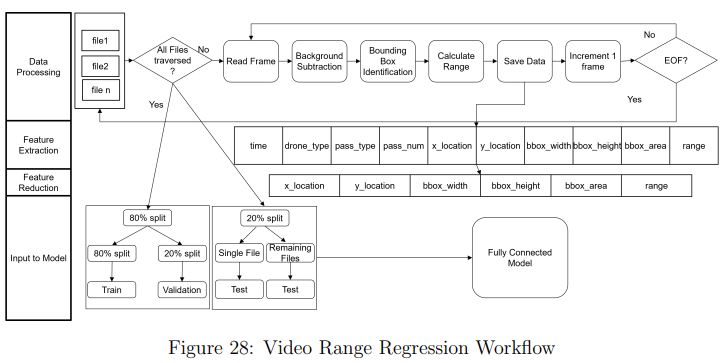

- 光学测距回归模型:构建训练全连接深度神经网络实现视频源测距(单位:米)

- 训练验证体系:采用多样化sUAS场景数据集对视觉/声学组件进行严格训练验证,优化模型鲁棒性

- 跨模态融合技术:开发创新融合算法整合视听信息,发挥多模态互补优势。融合核心目标在于证明"视听结合"较单模态具有更高预测精度

DDCC作为专有系统,通过传感器网络执行指令(如记录/预测)。其客户端界面采用3x3网格排列的九宫格视频流布局,每区块均支持"连接"、"录制"、"预测"、"静音"功能键,配备服务器主机配置文本框及远程重启下拉菜单。树莓派4服务器传输的实时音视频流显示于对应区块,捕获数据的分类预测结果集中呈现在日志域。系统可加载预训练模型执行定制化预测任务,本研究特训模型专注于基于视频/音频/融合数据的sUAS存在性识别与距离测算。

文档结构如下:第二章详述sUAS探测技术背景与研究进展;第三章解析DDCC系统设计与节点配置;第四章阐述数据采集、模型构建及训练验证方法论;第五章呈现全流程实验结果;第六章探讨未来sUAS数据采集路径;第七章总结研究并给出结论陈述。