生成式人工智能(Generative Artificial Intelligence,简称 Gen-AI)的迅猛发展,使高质量图像的生成变得轻而易举,但与此同时,也引发了关于知识产权保护、内容真实性与责任追溯等一系列关键问题。水印技术作为应对这些挑战的潜在解决方案,能够在区分 AI 生成图像与自然内容、确保内容溯源以及构建可信数字生态方面发挥重要作用。 本文对AI 生成图像水印技术的研究现状进行了全面综述,从以下五个关键维度展开: (1) 图像水印系统的形式化定义; (2) 各类水印技术的综述与比较; (3) 从视觉质量、容量与可检测性等方面的评估方法; (4) 面向恶意攻击的脆弱性分析; (5) 当前面临的主要挑战与未来发展方向。 本综述旨在为研究者提供对 AI 生成图像水印技术的整体理解,从而推动该领域的持续发展与完善。

1 引言

我们正处于一个生成式人工智能(Generative Artificial Intelligence, Gen-AI)迅猛发展的时代。作为一种变革性范式,Gen-AI 旨在生成富有创造性的内容,包括图像、文本、音频甚至代码。与传统的判别式模型(discriminative models)仅根据输入数据进行分类或预测不同,Gen-AI 模型通过学习数据的底层分布,从而基于训练集生成新的样本【29】。这种生成能力得益于深度学习的突破性进展,尤其是变分自编码器(VAE)【38】、生成对抗网络(GAN)【20】以及近年来最具代表性的扩散模型(diffusion models)等架构的发展。 如今,生成式人工智能正深刻地影响着曾经被认为是人类专属的领域。在自然语言生成方面,诸如 GPT-4【53】等模型能够以接近人类的语言流畅度和上下文理解能力,生成长篇小说、技术说明和对话内容。在图像合成方面,Midjourney【49】、DALL·E【56】和 Imagen【61】等商用工具使人们能够通过简单的文本提示生成逼真或艺术化的图像。在代码生成方面,GitHub Copilot 与 Cursor 等平台通过自动补全代码片段和函数建议来辅助开发者【86】。总体而言,生成式人工智能在多个生活和工作场景中展现出了前所未有的效率与可及性。 然而,Gen-AI 的便捷性是一把“双刃剑”。它在激发创造力的同时,也带来了安全与伦理问题。一方面,该技术可能被滥用于恶意用途,如深度伪造(deepfake)或非自愿色情内容的生成;另一方面,它也给知识产权(Intellectual Property, IP)保护带来了严峻挑战——艺术家与摄影师的原创作品可能被未经授权地篡改、模仿或使用,从而模糊了版权归属并削弱了创作者的权利执行能力。 综上,生成式人工智能带来的挑战可归纳为以下三个方面: (1) 知识产权与所有权:在数字环境中,内容易于复制与传播,保护知识产权与追踪所有权极具挑战性; (2) AI 生成内容(AIGC)的检测与源头识别:随着 AIGC 与真实内容愈发难以区分,判断内容是否为合成生成及其来源模型变得至关重要; (3) 责任追溯与滥用可追性:当合成内容被用于传播虚假信息或恶意目的时,追踪其传播路径与责任方异常困难。 为应对上述三大挑战,研究者将重点转向视觉领域,因为高保真 AI 生成图像常常与人类创作内容无缝融合,使得所有权、真实性与责任追溯问题尤为复杂。在此背景下,水印技术(Watermarking)被广泛认为是一种前景广阔且有效的解决方案。 尽管已有多篇综述论文为 AI 生成内容的水印研究提供了有价值的概览(参见表 1),但仍存在若干空白。本论文旨在填补这些空缺。Zhao 等人【86】与 Ren 等人【58】等基础性的知识系统化研究(Systematization of Knowledge, SoK)提出了优秀的跨模态水印分析框架,涵盖文本、图像与音频等多种模态;Liang 等人【42】的综述则系统回顾了大语言模型(LLMs)的水印研究,分析了多模态技术的继承关系。然而,这些研究的广泛范围限制了对视觉领域中安全性与鲁棒性等独特挑战的深入探讨。Luo 等人【46】从历史演进的角度,将水印方法从传统技术到扩散模型进行了分类;Duan 等人【13】则聚焦于扩散模型与视觉水印的相互作用,将其分为被动式与主动式两类。但二者均未充分讨论高级对抗性攻击问题。 为此,本文的主要贡献如下: * 系统综述 AI 生成图像水印研究现状,并给出水印系统的形式化定义,对主流的“生成中嵌入”水印方法进行系统分类,阐明其机制、优点与应用场景; * 突出安全性维度,对现有 AI 生成图像水印方案中的高级威胁进行较为系统的分析; * 深入探讨视觉质量、水印容量与可检测性,并总结最先进的水印攻击与防御策略,为后续研究提供清晰的技术路线图。

1.1 水印技术及其在可信 AI 中的作用

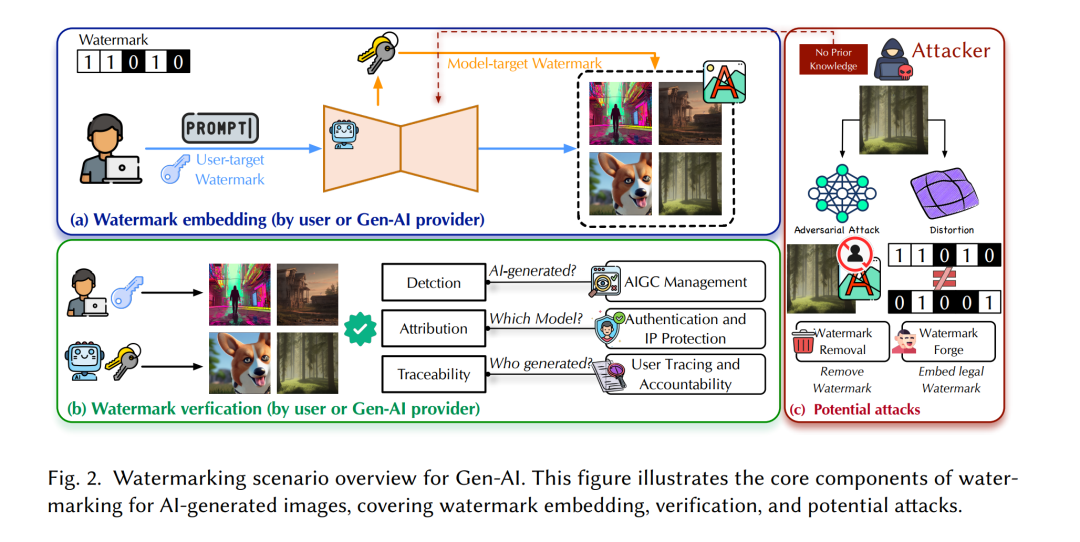

数字水印(Digital Watermarking)是一种在数字媒体中嵌入可见或不可见标识信息的技术,用于验证内容真实性、确立所有权并支持溯源追踪。同时,它也是区分自然内容与 AI 生成内容、确保数字生态系统中责任可追溯性的重要手段【43】。 典型的数字水印过程包括两个阶段:嵌入(embedding)与验证(verification)。在嵌入阶段,水印被嵌入图像中,同时尽量保持视觉质量;在验证阶段,通过提取水印并与参考水印或密钥比对,以确认内容的真实性或所有权。 然而,传统水印方法存在显著局限: (1) 由于水印未与图像生成过程集成,易受到几何攻击等干扰; (2) 作为后处理手段(post-hoc method),其水印与生成图像缺乏语义一致性,无法充分利用生成模型的潜在特征。 为克服这些问题,生成中水印(in-generation watermarking)作为一种主动式策略被提出。该方法允许 Gen-AI 用户或模型提供方在生成过程中直接嵌入隐藏信息或密钥(即水印),从而在保证图像语义与视觉质量的同时,实现知识产权保护、内容认证与责任追溯。如图 2 所示,该过程通过在生成结果中嵌入隐蔽但一致的信号来标记其生成源。后续可通过检测该信号实现真实性验证,而无需依赖统计差异。这种方式为识别与管理 AI 生成图像提供了一种更可靠的手段。 全球范围内,多个国家与地区正积极推进 Gen-AI 水印的立法与标准化: * 中国已明确要求对 AIGC 内容进行水印标识,以确保可追溯与监管【9】; * 欧盟通过《人工智能法案(AI Act)》【14】建立了涵盖机器可读水印的透明度要求; * 美国采用混合模式,结合行政命令【68】、NIST 指南【51】与行业自愿标准,推动水印机制的落地。

尽管各地区政策细节不同,但均认识到 Gen-AI 水印在应对虚假信息、保护知识产权与增强数字信任方面的关键作用,推动其全球化应用与标准化进程。 同时,业界也在积极推进水印实践: * Google 推出了主动嵌入式水印系统 SynthID【10】,通过在生成阶段直接植入水印以构建可信 AI; * OpenAI 支持 C2PA 标准【8】,并尝试通过加密元数据实现可互操作的内容溯源验证; * Meta 采用可见与不可见水印结合的标注机制【48】,并利用 C2PA 标签推动跨平台生态落地。

1.2 AI 生成图像水印的安全性与鲁棒性

尽管当前研究成果令人瞩目【16, 75, 77】,但现有 AI 生成图像水印方法仍存在显著局限。多数方法仅能抵抗常见图像失真(如压缩、裁剪、噪声),却无法防御高级对抗性攻击(如图 2 所示)。已有研究【2, 30, 34, 73, 76, 87】指出,现有系统在鲁棒性与安全性方面仍存在漏洞。 鲁棒性(Robustness)主要关注水印在图像经过修改、处理或攻击后能否存活。例如图像压缩、剪裁、噪声添加、再生成(regeneration)等均可能破坏水印。鲁棒性衡量水印抵御篡改的能力。 安全性(Security)则关注防止水印被未经授权地检测、伪造或滥用。安全性的核心在于确保水印系统的可信性与防伪性,使得只有授权方可嵌入与验证水印,防止攻击者利用水印机制进行伪造或冒用。 为解决这些问题,需设计既鲁棒又安全的水印系统,以确保 AI 生成图像在真实环境中的可追溯性。鲁棒性确保水印在图像生命周期中不被轻易破坏,是抵御“移除攻击”的第一道防线;安全性则防止水印被非法复制或伪造。例如,攻击者可能从合法图像中提取真实水印并嵌入恶意图像,以伪造来源,从而造成误导或信誉损害。 安全水印系统通常引入密码学机制,以确保仅授权用户可进行嵌入与验证,从而防止身份滥用并维护信任框架的完整性。 总之,以上挑战与需求共同界定了本研究的目标: 构建鲁棒、安全且可验证溯源的 AI 生成图像水印方法,为可信 AI 奠定基础。