新技术的出现及军事能力——尤其是在人工智能(AI)和自主武器系统(AWS)方面——的核心挑战和关切点在于人类控制,或者说控制的缺失。AI在现代战争中既作为战略资产,也作为重大的伦理挑战,持续出现在政策和学术讨论中,它有可能重塑军事能力的边界,并重新审视人类参与的程度和要求。这一点在AWS的语境中最为关键,因为其日益增长的复杂性迫切需要深入审视机器自主性与人类决策者的角色及要求之间的平衡。

为追求这一平衡,"有意义的人类控制"(MHC)概念应运而生。这是一个源于必要性而产生的概念,并提供了一个平台来重新审视和界定人类在关键且时间敏感的决策中的参与范围。随着各国努力应对新兴军事AI的潜力和实际问题,MHC已成为AWS监管的一个决定性特征。然而,MHC作为一个概念和术语,因其模糊性、缺乏实践以及全球共识的缺失而存在重大障碍。尽管如此,MHC所代表的核心关切——即人类决策在AWS部署中的作用——对于负责任且合法地将AI和自主性整合到军事系统和流程中至关重要,无论使用什么术语。尽管学术界努力推动议程朝着MHC的概念化方向发展,其中许多努力是富有成效且必要的,但仍有大量工作有待完成。

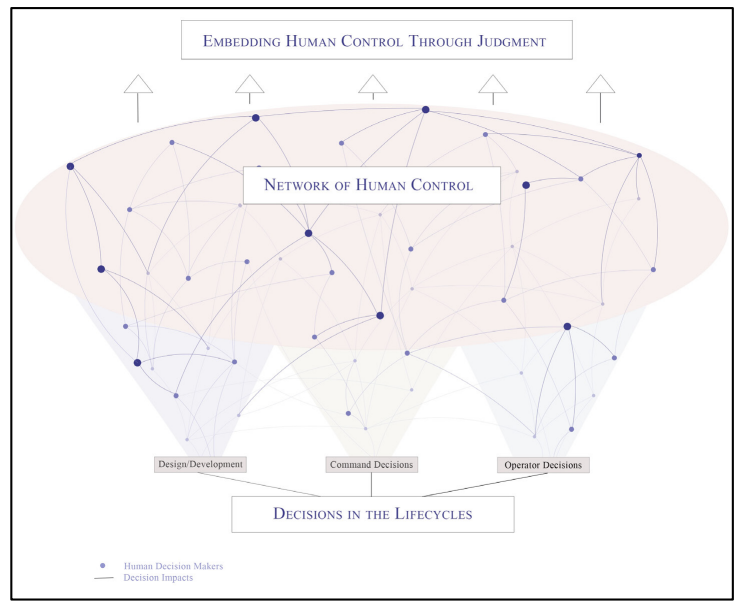

为了在自主系统中切实推进人类控制的实际实现,需要仔细审慎地审视决策者是谁,以及他们在武器系统整个生命周期中做出哪些决策。从概念化、设计、开发、采购、部署到处置,有许多人参与到一个武器系统的过程中,其中对于与AWS性能最相关的关键功能而言,某些角色的决策比其他角色更为重要。然而,识别和审视这些关键参与者并理解他们的角色,对于绘制人类参与、人类能力以及(潜在的)人类控制的网络是必要的。

本文是三部分系列文章的第一篇,该系列解构武器系统生命周期的各个阶段,以特别探讨在三个阶段做出的关键决策:设计与开发、作战部署和战术接战。审视每个阶段有助于更好地理解谁在做出这些决策、这些决策是什么、这些决策在何时做出,以及这些决策对武器系统性能的总体影响。这对AWS来说尤为关键,因为正如本系列将展示的,人类的决策和判断以多种方式与自主系统互动,并被嵌入到AWS中。任何对人类控制及其后续法律和政策影响的严谨探讨,都必须首先考虑哪些决策塑造和定义了系统的开发与部署、这些决策如何直接关系到系统性能,以及这些决策如何像拼图一样,共同构成一幅关于人类在这种尖端能力中所扮演角色和能力的更大叙事。本系列文章正是朝着这个目标迈出的一步。

生命周期框架通常包括六个阶段:设计/开发、测试与评估、生产与采购、作战部署、处置以及使用后审查。人类控制可能在任何一个阶段丧失或被利用,这就是为什么更深入地考虑这个时间线至关重要。

虽然这个有限的系列只考察三个阶段,但这当然不是详尽无遗的。要全面理解生命周期每个阶段的人类参与和控制,还需要做更多的工作。本系列从作战和战术两个角度考察设计与开发以及作战部署阶段。然而,本文专门讨论第一阶段:设计与开发。

在评估人类控制时,仅关注机器学习系统,因为这些系统代表了大多数专家认为的人类控制程度最低的场景。以此方式,机器学习自主武器将代表实现MHC最具挑战性的案例。因此,这第一篇文章探讨设计/开发阶段,特别是多个机器学习过程,以及机器学习设计者、开发人员和工程师在创建这些模型时所做的决策。这展示了人类决策和参与在开发机器学习模型中的范围和潜力,从而说明人类判断如何能够体现并嵌入到机器学习AWS中。

本系列的第二篇文章将考察指挥官在作战规划过程中的决策,以此作为人类控制的一种体现。这包括对作战背景、进攻与防御规划以及法律问题的考量。从根本上说,它探讨了指挥官在规划阶段的决策,并详细说明了这些决策如何构成武器系统生命周期中的有意义的人类控制或嵌入式人类判断。

第三篇文章考察最常与MHC关联的阶段:负责使用AWS的操作员的决策。这是一个需要考虑的关键阶段,因为通常认为MHC存在于此处,或者说在AWS部署中MHC理应存在于此处。该文章探讨了那些现存的论点,并最终论证作战使用阶段本身不足以体现MHC或适当的人类判断,因为其范围极其有限;相反,它仅仅是更大的人类控制网络中的一部分。

本系列旨在证明,在机器学习自主武器系统的背景下,人类判断是由许多利益相关者在生命周期的许多阶段嵌入的。只有从整体上看,才能充分理解这个作为生命周期天然组成部分的人类判断网络。这并不是说AWS的开发或部署中没有剩余的法律关切或伦理挑战了——远非如此。相反,目标是敦促学术研究人员和政策制定者拓宽人类控制的范围,朝着一个整体或全面的图景发展,即理解自主系统是如何开发的、机器学习模型的能力是什么,以及整合这种新能力可能克服或新引入哪些法律和作战挑战。其他学者也曾主张拓宽关于新兴技术和人类角色的范围,但通常是为了将MHC问题扩展到武器语境之外,并探讨人类控制对于非武器化的军事AI系统(如用于目标选定周期的决策支持系统)同样复杂的情况。然而,更深入地探讨武器讨论,追踪人类控制在特定生命周期阶段如何被具体实现,以说明不同阶段的不同行动者如何为一个更大的人类控制网络做出贡献。简而言之,需要先拉近镜头审视决策者,然后才能拉远镜头以全面理解人类控制网络,并恰当地利用或规范它。

由于人类控制的理念仍然是学术界和政策界关于AWS讨论和辩论的核心,并且各国正试图实施人类控制的框架(例如澳大利亚和美国),因此认识到哪些因素和哪些人与实际且全面地理解人类控制相关,是至关重要的。

值得注意的是,在围绕AWS和人类控制的持续讨论和辩论中,存在许多各学科和对话之间相互错失交集的机会。这一领域充满了对AI或机器学习能力的误解,使用着不同的AWS定义,或者缺乏必要的技术知识来理解这种新兴技术及其军事应用所涉及的风险。本系列也旨在为关于这一关键问题的法律、作战和技术讨论与分析提供一个公平的竞争环境。跨学科的参与和知识交流对于更广泛地培育任何未来自主武器系统或军事AI的负责任和合法的整合至关重要。技术、法律和作战上的必要性在军事AI和自主武器的发展中紧密相连,这些文章并没有忽视这种复杂性,而是直接应对它。

作为三部分系列的第一篇,本文后续结构如下。首先,有必要理解有意义的人类控制(MHC)这一概念,其在政治领域的演变,以及制定或实施此类概念所面临的实际挑战。这包括简要描述各国围绕人类对AWS控制的立场,以及从技术、政策和军事角度选择合适术语所面临的挑战。

其次,借鉴那些应对人类在自主性之中及之上控制挑战的学科,本文探讨一个"嵌入式人类判断"的框架,以捕捉各学科在应对自主性中人类控制挑战时的共同点。

第三,本文讨论了国际法在MHC领域的相关性,并考量是否存在关于最低限度人类参与标准的法律要求。

第四,本文详细介绍了现代机器学习过程——它们是什么以及能做什么——以评估人类在当代机器学习模型设计和开发中的作用。

第五,本文考察了人类判断如何通过三个早期的设计和开发过程被嵌入到AWS中。这三个过程包括围绕训练数据、创建软件架构和设计系统界面的过程。目的并非详尽无遗地列出人类判断可能被嵌入AWS的所有途径,而是通过一些非技术受众可能不熟悉的例子,来审视这些决策以及做出这些决策的关键参与者。这有助于就该人类控制问题进行更细致、更知情的研究和参与。