题目: Differentiation and Weighted Model Integration

摘要:

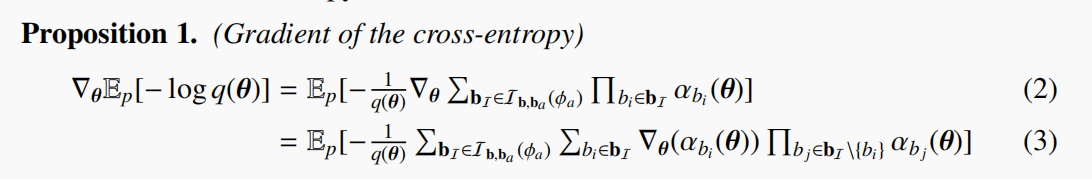

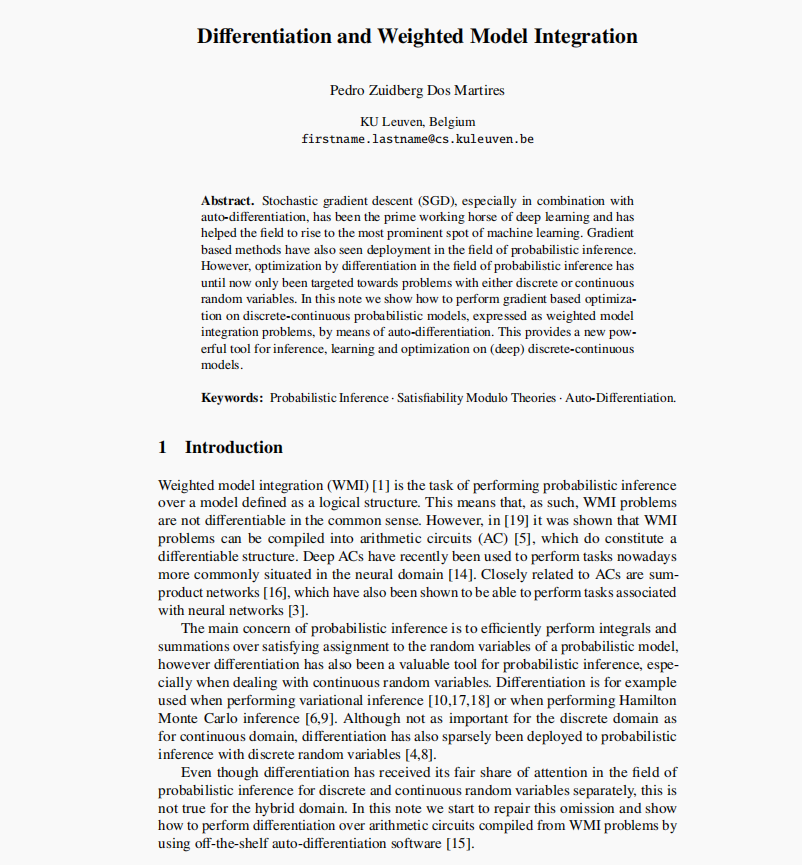

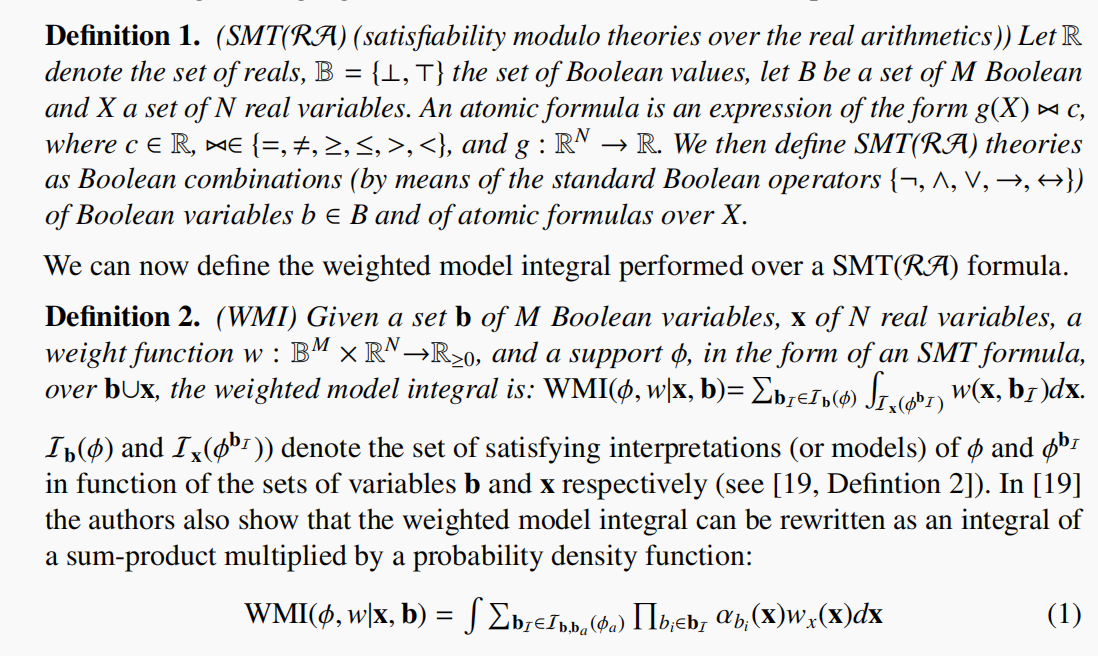

随机梯度下降(SGD),特别是与自动微分相结合一直是深度学习的主要工作,并帮助该领域上升到机器学习最突出的位置。基于梯度的方法在概率推理领域也得到了应用。然而,迄今为止,概率推理领域的微分优化仅针对离散或连续随机变量的问题。在这篇笔记中,我们展示了如何执行基于梯度的优化离散连续概率模型,表示为加权模型积分问题,通过自动微分。这为(深度)离散-连续模型的推理、学习和优化提供了一个新的强大工具。

邀请嘉宾:

Pedro Zuidberg Dos Martires现在是鲁汶大学DTAI实验室Luc De Raedt主管的博士生。研究关注概率编程,更具体地说是概率逻辑编程。在ReGROUND项目中,还研究了概率逻辑编程在机器人领域的应用。

成为VIP会员查看完整内容

相关内容

专知会员服务

32+阅读 · 2020年2月8日

专知会员服务

24+阅读 · 2019年12月30日

专知会员服务

18+阅读 · 2019年12月25日

专知会员服务

48+阅读 · 2019年11月30日

Arxiv

14+阅读 · 2019年9月17日

Arxiv

5+阅读 · 2018年1月26日