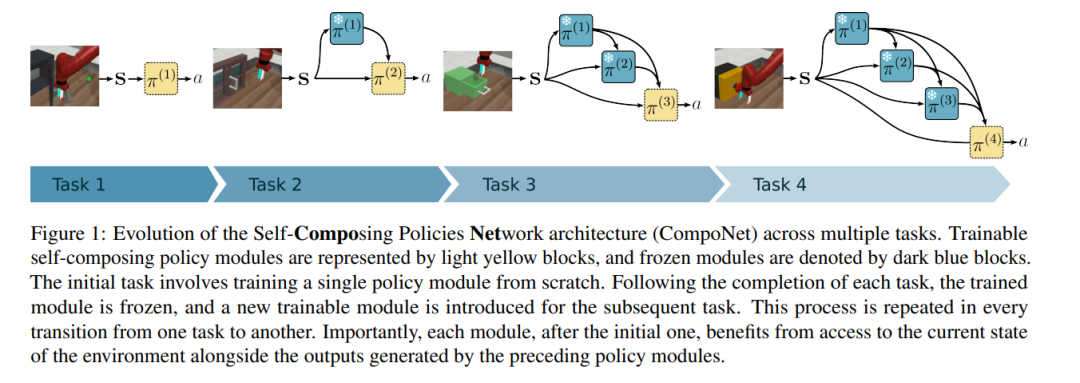

本研究提出了一种可增长且模块化的神经网络架构,用于持续强化学习,能够自然地避免灾难性遗忘与任务间干扰。该架构中每个模块的结构支持将以往策略与自身内部策略有选择地组合,从而加速当前任务的学习过程。与以往的可增长神经网络方法不同,我们证明了所提出方法的参数数量随任务数量呈线性增长,且在扩展规模的同时不牺牲模型的可塑性。

在标准的连续控制与视觉任务基准测试中,实验结果表明该方法在知识迁移与性能方面均优于现有的其他方法。

成为VIP会员查看完整内容

相关内容

Arxiv

42+阅读 · 2023年4月19日

Arxiv

86+阅读 · 2023年4月4日

Arxiv

152+阅读 · 2023年3月29日