对比学习

·

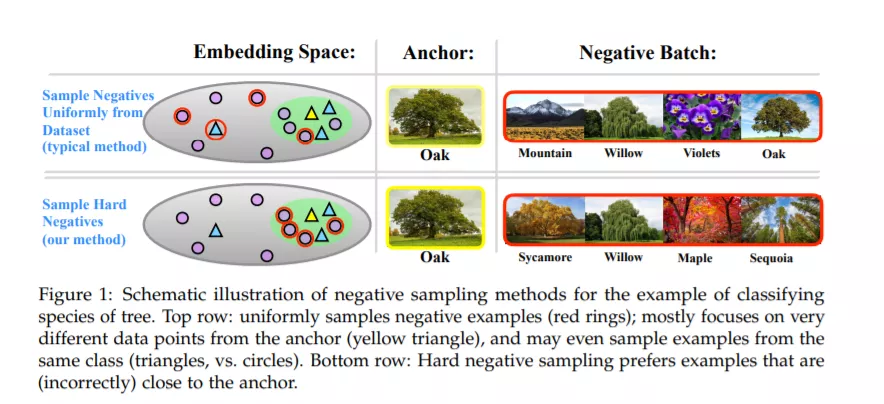

我们考虑这样一个问题:你如何为对比学习抽取好的负样本例子?我们认为,与度量学习一样,学习对比表示法受益于硬负样本(即,点很难与锚点区分)。使用硬负样本的关键挑战是对比方法必须保持无监督,使得采用现有的使用标签信息的负样本抽样策略不可行。作为回应,我们开发了一种新的无监督的方法来选择硬负样本,在那里用户可以控制硬负样本的数量。这种抽样的极限情况会导致对每个类进行紧密聚类的表示,并将不同的类推到尽可能远的地方。该方法提高了跨模态的下游性能,只需要少量的额外代码来实现,并且没有引入计算开销。

成为VIP会员查看完整内容

相关内容

Arxiv

1+阅读 · 2020年11月19日